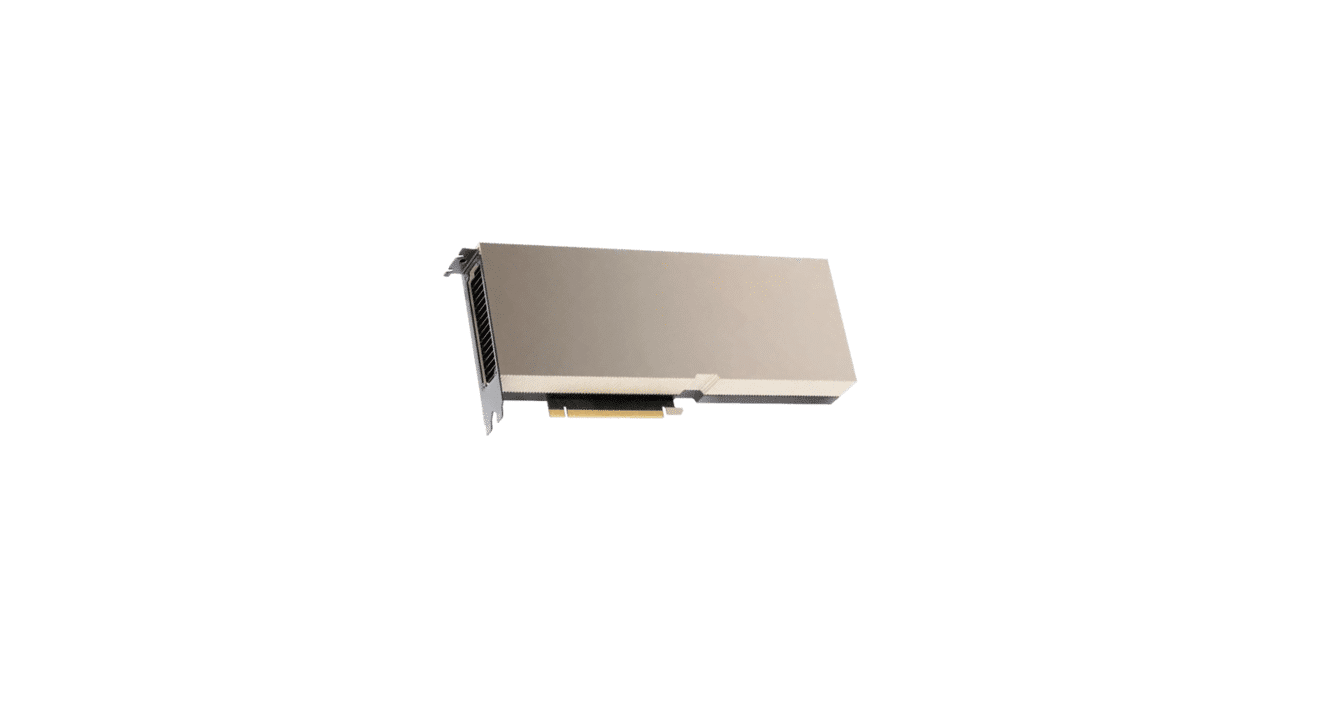

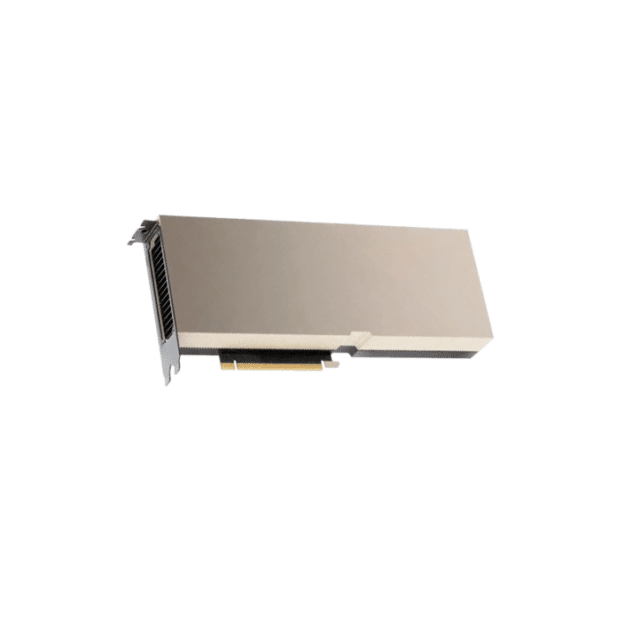

NVIDIA H100 80GB PCIe - é uma unidade de processamento gráfico (GPU) de ponta baseada na arquitetura NVIDIA Hopper, projetada para os aplicativos mais exigentes em inteligência artificial (IA), aprendizado de máquina, aprendizado profundo e computação de alto desempenho (HPC). A H100 80GB PCIe define novos padrões de desempenho ao oferecer uma aceleração sem precedentes para o treinamento e a implantação de modelos de IA, além de resolver os problemas científicos mais desafiadores. Essa GPU é a escolha ideal para organizações que buscam a liderança em seus campos.

Principais recursos e benefícios da NVIDIA H100 80GB PCIe:

-

Arquitetura NVIDIA Hopper: Proporciona um salto significativo no desempenho em relação às gerações anteriores de GPUs.

-

Memória HBM3 de 80 GB: A memória de alta velocidade oferece uma largura de banda incrível e processamento eficiente de grandes quantidades de dados.

-

Kernels de tensor de quarta geração: Acelere a computação relacionada à IA e à aprendizagem profunda, levando-a para o próximo nível.

-

Mecanismo do transformador: Um mecanismo especializado para acelerar o aprendizado e a inferência de modelos de linguagem grandes (LLMs).

-

NVIDIA NVLink: Fornece comunicação de alta velocidade entre GPUs para tarefas com uso intensivo de recursos (ao usar várias GPUs).

-

PCIe Gen5: Suporta o padrão PCIe mais recente para obter o máximo de rendimento de dados.

-

Desempenho para IA: Desempenho inigualável para treinamento e implantação de modelos de IA de última geração.

-

Desempenho para HPC: Otimizado para acelerar a computação e a modelagem científicas.

-

Confiabilidade e estabilidade: Oferece desempenho confiável nos ambientes mais exigentes.

A quem se destina o NVIDIA H100 80GB PCIe?

-

Organizações de pesquisa: Para acelerar a computação científica e a análise de big data.

-

Empresas de IA: Treinar e implementar modelos avançados de aprendizado de máquina e aprendizado profundo.

-

Provedores de serviços em nuvem: Para implementar a capacidade de computação de alto desempenho.

-

Empresas de big data: Analisar e processar grandes conjuntos de dados.

-

Organizações que trabalham no setor de tecnologia financeira: Para modelagem de risco e negociação de alta frequência.

-

Setor de saúde: Para desenvolver novos medicamentos e analisar imagens médicas.

Comprar NVIDIA H100 80GB PCIe:

Se você se esforça para obter o máximo de desempenho e está procurando uma solução sem compromisso para suas necessidades de computação, NVIDIA H100 80GB PCIe - é a sua escolha. Entre em contato com nossos especialistas para obter informações detalhadas sobre especificações técnicas, recursos e preços. Nós o ajudaremos a encontrar a melhor configuração e forneceremos suporte profissional.

Especificações da NVIDIA H100 80GB PCIe

1. características gerais:

-

Arquitetura de GPU: NVIDIA Hopper

-

Fator de forma: Placa de expansão PCIe

-

Aplicativo de destino: Inteligência artificial (IA), aprendizado de máquina, aprendizado profundo, computação de alto desempenho (HPC), análise de dados

-

Tipo: Placa PCIe (instalada em um sistema de servidor)

2. Unidade de processamento gráfico (GPU):

-

Número de núcleos CUDA: 14592

-

Número de kernels de tensor: 576 (4ª geração)

-

Motor do transformador: Sim

-

Frequência da GPU: As frequências base e de reforço variam de acordo com a carga de trabalho e o sistema de resfriamento

-

Techprocess: 4nm (TSMC 4N)

-

Suporte a PCIe: PCIe Gen5

3. Memória:

-

Capacidade de memória: 80 GB HBM3

-

Largura de banda da memória: 3 TB/s

-

Interface de memória: 5120 bits.

4. Desempenho (valores aproximados, podem variar):

-

FP64 (ponto flutuante de precisão dupla): Alto desempenho para computação científica.

-

FP32 (ponto flutuante de precisão única): Alto desempenho para tarefas de uso geral.

-

Desempenho do núcleo do tensor: Desempenho inigualável para tarefas de IA e aprendizagem profunda.

-

INT8 (desempenho inteiro): Alto desempenho para tarefas de IA.

5. Interfaces:

-

NVLink: Não disponível na versão PCIe (suporte a NVLink na versão SXM)

-

PCIe: PCIe Gen5 x16

6. Funcionalidade:

-

GPU multi-instância (MIG): Suportado, mas o número de instâncias depende da configuração.

-

Pilha de software NVIDIA AI: Suporte a várias bibliotecas e estruturas de IA, como CUDA, cuDNN, TensorFlow, PyTorch, etc.

-

GPUs de data center da NVIDIA: Otimizado para uso em data centers.

-

GPU NVIDIA Multi-Instance (MIG): Oferece suporte à divisão de GPUs em instâncias separadas.

7. consumo de energia:

-

TDP (Thermal Design Power): 350 W (pode variar dependendo da carga de trabalho)

-

Sistema de resfriamento: É necessário um sistema de resfriamento ativo (geralmente um radiador e ventiladores).

-

Nutrição: Fonte de alimentação externa (requer a unidade de fonte de alimentação apropriada)

8. Características físicas:

-

Dimensões: Fator de forma PCIe padrão, o comprimento pode variar.

-

Peso: Depende do desempenho específico.

9. Sistemas operacionais compatíveis:

-

Linux (suporte básico)

-

Windows (suporte limitado)

10. Requisitos do sistema:

-

Placa-mãe compatível: Com suporte a PCIe Gen5 e slots suficientes.

-

Fonte de alimentação compatível: Energia suficiente para alimentar a GPU e o restante do sistema.

-

Sistema de resfriamento adequado: Para dissipação eficiente de calor.

-

Motoristas: É recomendável que você use as versões mais recentes dos drivers NVIDIA.

Observações importantes:

-

Versão PCIe: Essas especificações são para a versão PCIe da NVIDIA H100 80GB. As especificações podem ser diferentes da versão SXM.

-

Configuração do sistema: O desempenho da GPU depende da configuração de todo o sistema, incluindo processador, memória e armazenamento.

-

Atualizar: A NVIDIA está constantemente atualizando seus drivers e software, por isso é importante mantê-los atualizados.

-

Especificações oficiais: Para obter as especificações mais precisas e completas, consulte a documentação oficial da NVIDIA.