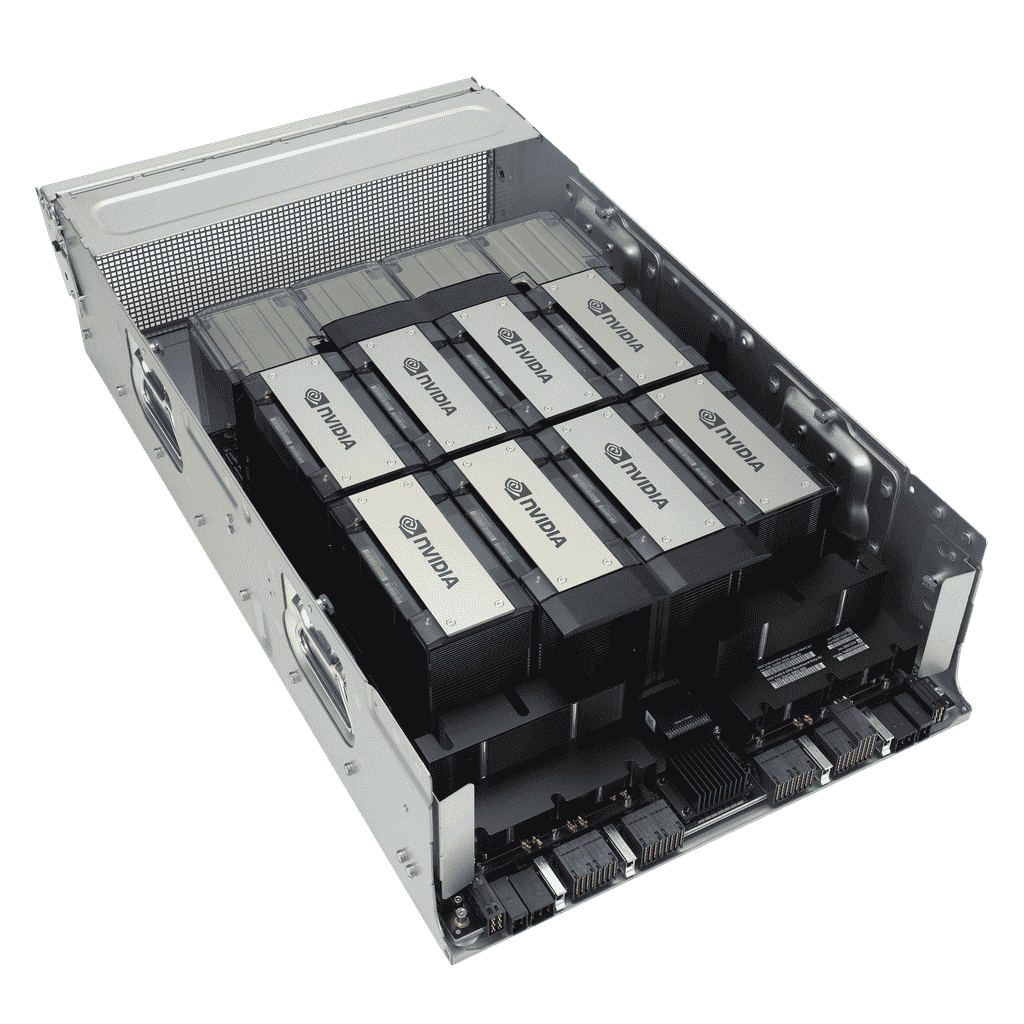

Sistema com NVIDIA H100 8 GPU é uma poderosa solução de computação projetada para os aplicativos mais exigentes em inteligência artificial (IA), aprendizado de máquina, aprendizado profundo e computação de alto desempenho (HPC). Com oito GPUs NVIDIA H100, essa configuração oferece desempenho e escalabilidade sem precedentes, abrindo novos horizontes para pesquisa e desenvolvimento. O sistema H100 de 8 GPUs é a escolha ideal para organizações que desejam liderar em seus campos e precisam de potência máxima de computação.

Principais recursos e benefícios do sistema NVIDIA H100 8 GPUs:

-

8 GPUs NVIDIA H100: Fornecer o máximo de potência de processamento paralelo para tarefas de IA e HPC.

-

Arquitetura NVIDIA Hopper: Garante o mais alto desempenho e eficiência ao lidar com as tarefas mais exigentes.

-

Memória HBM3: A memória de alta velocidade garante a transferência rápida de dados e o manuseio eficiente de grandes quantidades de dados.

-

Kernels de tensor de quarta geração: Acelere os cálculos relacionados à IA e à aprendizagem profunda, proporcionando maior velocidade e eficiência.

-

Motor do transformador: Acelera a aprendizagem e a inferência de modelos de linguagem grandes (LLMs).

-

NVLink: Fornece comunicação de alta velocidade entre GPUs, permitindo que você resolva com eficiência problemas computacionais complexos (depende da implementação).

-

PCIe Gen5: Suporta o padrão PCIe mais recente para obter o máximo de rendimento de dados (dependendo da implementação).

-

Escalabilidade: A configuração pode ser dimensionada para lidar com as tarefas que exigem mais recursos.

-

Otimização para IA: O sistema é otimizado para trabalhar com várias estruturas de IA e oferecer o máximo de desempenho.

-

Confiabilidade: Componentes e sistemas de resfriamento de alta qualidade garantem uma operação estável e confiável.

Para quem foi projetado o sistema NVIDIA H100 8 GPU?

-

Institutos de pesquisa: Para computação científica avançada e análise de big data.

-

Empresas de IA: Para treinamento e implementação de modelos de aprendizagem automática e profunda de última geração.

-

Provedores de serviços em nuvem: Para implementar a capacidade de computação de alto desempenho para seus clientes.

-

Organizações envolvidas no processamento de big data: Analisar e processar grandes conjuntos de dados em tempo real.

-

Empresas de tecnologia financeira: Para modelagem de risco financeiro, negociação de alta frequência e análise de mercado.

-

Organizações médicas: Para o desenvolvimento de novos medicamentos, análise de imagens médicas e pesquisa genômica.

Comprar o sistema NVIDIA H100 8 GPU:

Se você está procurando desempenho máximo e uma solução sem compromisso para tarefas de IA e HPC, o sistema NVIDIA H100 8 GPU - é a sua escolha. Entre em contato com nossos especialistas para obter informações detalhadas sobre configuração, especificações, recursos e preços. Nós o ajudaremos a encontrar a melhor solução e forneceremos suporte profissional.

Especificações para um sistema com 8 GPUs NVIDIA H100

1. características gerais:

-

Tipo: Um sistema de computação de alto desempenho para IA, aprendizado de máquina, aprendizado profundo e HPC

-

Atribuição: Treinamento e implantação de modelos de IA, computação de alto desempenho, modelagem científica, análise de dados

-

Fator de forma: Depende do fabricante do servidor (normalmente, montagem em rack 4U-8U)

-

Fabricante: Depende do fornecedor, pode ser Supermicro, Dell, HPE, Inspur, etc.

2. Unidades de processamento gráfico (GPUs):

-

GPU: 8 x GPUs NVIDIA H100 com núcleo tensor

-

Capacidade de memória da GPU: 80 GB de HBM3 por GPU

-

Interface da GPU: PCIe Gen5 ou SXM (dependendo da configuração)

-

Tecnologias NVIDIA: Suporte a Tensor Cores, NVLink (dependente da configuração), CUDA, Transformer Engine

-

Arquitetura: NVIDIA Hopper

3. Unidades centrais de processamento (CPUs):

-

Processadores compatíveis: Dois processadores Intel Xeon Scalable de 4ª geração ou AMD EPYC de 4ª geração (dependendo da plataforma)

-

Número de soquetes: 2

-

TDP: Depende do modelo de processador selecionado

-

Número de núcleos: Depende do modelo de processador selecionado

4. Memória (RAM):

-

Tipo de memória: DDR5 ECC RDIMM/LRDIMM

-

Slots DIMM: Depende da plataforma (normalmente de 16 a 32 slots)

-

Capacidade máxima de memória: Depende da plataforma e dos módulos de memória (normalmente, até vários TB)

-

Velocidade da memória: Depende dos processadores e módulos selecionados

5. Subsistema de armazenamento:

-

Compartimentos de unidade: Depende da plataforma (normalmente, de 8 a 24 ou mais compartimentos de 2,5″ ou 3,5″)

-

Tipos de unidades: SSD/HDD NVMe, SATA, SAS

-

Suporte a RAID: RAID de hardware ou software (dependente do controlador)

6. Slots de expansão:

-

Slots PCIe: Depende da plataforma (normalmente PCIe Gen5 x16 para GPU e Gen5/Gen4 para outras placas)

-

Suporte para mapas adicionais: Placas de rede, controladores RAID, InfiniBand

7. Interfaces de rede:

-

Ethernet embutida: Depende da plataforma (normalmente 2 ou 4 portas 10 Gigabit Ethernet (10GbE) ou 1 Gigabit Ethernet (1GbE))

-

Adaptadores de rede opcionais: 25GbE, 40GbE, 100GbE, 200GbE e InfiniBand (dependendo da configuração)

8. Sistema de resfriamento:

-

Tipo: Resfriamento a ar (radiadores e ventiladores ativos)

-

Opções de resfriamento líquido: Disponível em algumas configurações

-

Eficiência: O sistema de resfriamento é otimizado para dissipar o calor de 8 GPUs e processadores

9. Gerenciamento e monitoramento:

-

Sistema de controle: BMC (Baseboard Management Controller) com interface da Web

-

Monitoramento do sistema: Monitoramento de temperatura, tensão, velocidade do ventilador, consumo de energia e outros parâmetros

-

Gerenciamento remoto: Capacidade de gerenciar remotamente o servidor via IPMI

10. Fonte de alimentação:

-

Fontes de alimentação: Fontes de alimentação redundantes com troca a quente

-

Capacidade da fonte de alimentação: Depende da configuração, normalmente de 2000 W a 4000 W ou mais

-

Eficiência energética: Em conformidade com o padrão 80 PLUS Platinum/Titanium

11. Características físicas:

-

Dimensões (HxWxH): Depende da plataforma de servidor selecionada (normalmente montagem em rack 4U-8U)

-

Peso: Depende da configuração

12. Sistemas operacionais compatíveis:

-

Linux (suporte básico)

-

Windows Server (suporte limitado)

13. Recursos adicionais:

-

NVLink: Suporte NVLink para comunicação de GPU intra-servidor de alta velocidade (dependente da implementação)

-

Pilha de software NVIDIA AI: Suporte para CUDA, cuDNN, TensorFlow, PyTorch e outras bibliotecas para IA

-

MIG (GPU multi-instância): Oferece suporte ao compartilhamento de recursos de GPU em várias instâncias.

Observações importantes:

-

Configuração: As especificações podem variar muito, dependendo da configuração específica do servidor, incluindo os processadores, a memória, o armazenamento, as placas de rede e outras opções selecionadas.

-

Atualizar: Os fabricantes de servidores e a NVIDIA estão constantemente atualizando seus produtos, portanto, é importante verificar as especificações atuais na documentação oficial.

-

Especificações oficiais: Para obter as especificações mais precisas e completas, consulte a documentação oficial dos fabricantes de servidores e da NVIDIA.

Comentários

Ainda não há comentários.